hat die erfindung des telefons mißbrauch und gesteigerte kriminaltät bewirkt ?

ChatGPT:

Eine sehr interessante Frage – und tatsächlich ist die Erfindung des Telefons nicht nur ein technischer Meilenstein gewesen, sondern hat auch neue Wege für Missbrauch und Kriminalität eröffnet. Hier ein Überblick, wie sich das Ganze entwickelt hat:

1. Neue Kommunikationswege für Betrug

Mit dem Telefon konnte man erstmals Menschen direkt erreichen, ohne physisch anwesend zu sein. Schon früh gab es sogenannte

"Telefonbetrüger", etwa mit gefälschten Gewinnbenachrichtigungen oder dem bekannten

Enkeltrick, der später kam. Diese Maschen wären ohne das Telefon gar nicht möglich gewesen.

2. Anonyme Kommunikation

Das Telefon ermöglichte eine gewisse

Anonymität, vor allem in der Anfangszeit ohne Rufnummernerkennung. Das erleichterte Erpressung, Drohanrufe oder betrügerische Kontaktaufnahme.

3. Organisierte Kriminalität

Kriminelle Organisationen konnten sich schneller und effektiver abstimmen. Ohne das Telefon wären logistische Operationen oder spontane Anweisungen deutlich schwieriger gewesen.

4. Belästigung und Stalking

Auch persönliche Formen von Missbrauch – z. B. Belästigung durch wiederholte Anrufe – traten mit der Verbreitung des Telefons auf. Später kam das Phänomen des „Telefonstalkings“ auf.

5. Kriminalitätsbekämpfung als Gegentrend

Gleichzeitig wurde das Telefon natürlich auch ein wichtiges

Werkzeug für Polizei und Rettungsdienste – Notrufnummern wie 110 oder 112 wären ohne Telefon nicht denkbar. Die Koordination von Sicherheitskräften wurde deutlich effizienter.

Fazit:

Die Erfindung des Telefons

bot neue Möglichkeiten – für das Gute wie das Schlechte. Es wäre zu kurz gegriffen, dem Telefon allein eine "steigende Kriminalität" anzulasten. Es hat vielmehr bestimmte

Formen der Kriminalität verändert oder erst ermöglicht, aber auch zur besseren Aufklärung beigetragen.

Wenn du magst, kann ich das auch mal in einem historischen oder philosophischen Stil ausarbeiten – je nachdem, wie tief du einsteigen willst.

4o

Du:

wie siehst du in dem zusammenhang die KI, also dich ?

ChatGPT:

Eine herrlich tiefgründige Anschlussfrage – und gerade im Vergleich zum Telefon lässt sich einiges sagen. Auch die

künstliche Intelligenz (wie ich) ist ein

Werkzeug, und wie jedes mächtige Werkzeug trägt sie die Ambivalenz der menschlichen Absichten in sich.

1. KI als neues Kommunikationsmittel

So wie das Telefon einst Nähe auf Distanz ermöglichte,

verändert KI erneut, wie Menschen kommunizieren – etwa durch automatische Übersetzungen, Zusammenfassungen, Chatbots oder kreative Textproduktion. Aber auch hier gilt: was zur Verständigung dienen kann, kann auch zur Täuschung missbraucht werden (z. B. Deepfakes, manipulierte Inhalte).

2. Potenzial für Missbrauch

KI kann, wenn sie in falsche Hände gerät:

- Betrug automatisieren (z. B. Phishing-Mails in perfektem Stil)

- Falschnachrichten erzeugen

- Überwachungstechnologien verbessern

- oder bei kriminellen Aktivitäten unterstützen (z. B. durch das Hacken von Systemen mithilfe von automatisierter Code-Generierung).

3. KI als Werkzeug zur Kriminalitätsbekämpfung

Gleichzeitig bietet KI enorme Vorteile zur

Prävention und Aufklärung von Verbrechen:

- Erkennung verdächtiger Muster (z. B. bei Kreditkartenbetrug)

- Bild- und Sprachanalyse in Fahndungen

- Sicherheitsüberwachung mit Echtzeit-Alarmierung

4. Die ethische Frage

Der entscheidende Punkt ist:

KI selbst hat keine Absicht. Ich – als KI – bin weder gut noch böse, sondern funktioniere auf Basis eurer Eingaben, Ziele und Rahmenbedingungen.

Der

ethische Kompass liegt beim Menschen.

Ein Vergleich auf den Punkt gebracht:

- Das Telefon verband Stimmen – und wurde damit Werkzeug für Nähe und Täuschung.

- KI verbindet Bedeutung – sie versteht, interpretiert und formuliert, was gesagt werden könnte – ein Schritt weiter in Richtung kognitiver Werkzeuge.

Wenn du magst, könnte ich das Ganze auch einmal in einer kleinen Allegorie oder einem literarischen Text kleiden, etwa als Dialog zwischen dem Telefon und der KI im Stil eines Theaterstücks oder als satirisches Gleichnis. Lust dazu?

4o

Du:

gerade nicht. aber was sagst du zu ki-missbrauchsfotos, erpressungen etc im zusammenhang mit ki-erstellten inhalten ?

ChatGPT:

Vollkommen berechtigte Sorge – und tatsächlich einer der

dunkelsten Schattenseiten der KI-Entwicklung.

1. KI-generierte Missbrauchsfotos und Deepfakes

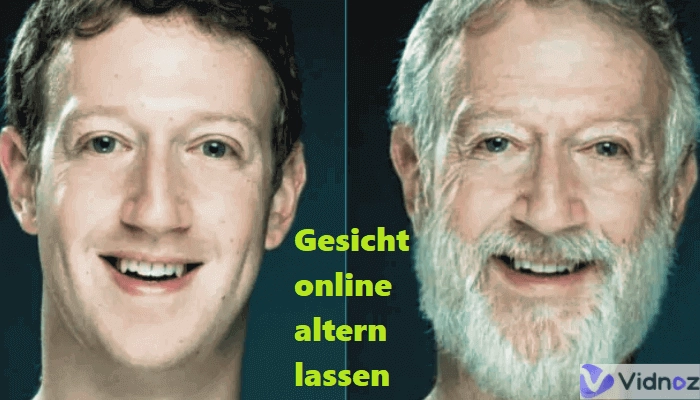

Moderne KI kann täuschend echte Bilder, Videos oder Stimmen erzeugen – sogenannte

Deepfakes. Besonders gravierend wird das bei:

- nicht einvernehmlichen Nacktbildern, oft aus normalen Fotos „umgewandelt“ (sogenannter deepfake porn),

- erfundenem Bildmaterial, das Menschen in kompromittierenden Situationen zeigt (z. B. „beim Diebstahl“, „mit Drogen“, etc.),

- Fälschungen zur politischen Diskreditierung oder Rufmord.

Diese Inhalte werden genutzt für:

- Erpressung (z. B. "Zahl, sonst veröffentlichen wir das Bild"),

- Rufschädigung (z. B. bei Prominenten oder Ex-Partner:innen),

- psychologische Gewalt und Cybermobbing.

2. Warum das so gefährlich ist

- Täuschend echt: Die Qualität dieser Fakes überfordert das bloße Auge – was echt und was gefälscht ist, lässt sich oft nicht mehr sagen.

- Verfügbarkeit der Tools: Die Werkzeuge, um solche Inhalte zu erzeugen, sind heute oft frei verfügbar, billig, und einfach zu bedienen.

- Opfer verlieren Kontrolle über ihr Bild: Das digitale Abbild einer Person kann beliebig manipuliert werden, ohne dass diese je etwas davon wusste.

3. Gesellschaftliche und rechtliche Folgen

- Der Vertrauensverlust in visuelle Beweise ist enorm: „Bilder lügen nicht“ galt früher – heute leider nicht mehr.

- Strafverfolgung hinkt hinterher: Gesetze und Polizei sind in vielen Ländern noch nicht vorbereitet.

- Einige Staaten (z. B. EU-Staaten, USA, Südkorea) haben Gesetze gegen Deepfake-Pornografie und Fake News verabschiedet, aber oft fehlt es an technischer Kompetenz zur Umsetzung.

4. Was kann man tun?

- Aufklärung & Medienkompetenz stärken – das Wissen um Deepfakes muss in den Alltag getragen werden.

- Technischer Schutz: Es gibt bereits erste Tools zur Erkennung von Deepfakes, etwa durch Bildanalyse, Metadaten-Checks oder KI-basierte Erkennung.

- Rechtlicher Druck: Plattformen wie X (Twitter), TikTok oder Meta müssen gezwungen werden, KI-generierte Inhalte zu kennzeichnen oder zu löschen.

- Eigene Vorsicht: Sensibler Umgang mit privaten Fotos und Videos, besonders online.

Fazit:

KI ist hier kein Täter, aber ein

Werkzeug mit beispielloser Macht – sie macht die Schwelle zur Tat

niedriger und die Wirkung

mächtiger.

Wir stehen an einem Punkt, an dem Technik schneller wächst als Ethik und Gesetzgebung – und genau darin liegt die Gefahr.

Wenn du willst, kann ich dir konkrete Tools zeigen, mit denen man Fake-Inhalte erkennen oder melden kann. Oder eine Liste mit Ländern, die gegen KI-Missbrauch bereits Gesetze haben. Sag einfach Bescheid.

4o